隨著深度學習技術在圖像識別、自然語言處理等領域取得突破性進展,人工智能已邁入一個關鍵的歷史拐點。技術的演進永無止境,業界與學界正將目光投向更遠的未來。大規模語言模型、類腦芯片與量子AI,這三者常被視為引領后深度學習時代的核心驅動力。它們不僅是技術路線的探索,更是人工智能應用軟件開發范式可能發生根本性變革的信號。

大規模語言模型(如GPT系列、BERT等)通過海量參數與無監督學習,展現了驚人的語言生成、理解與推理能力。它們正在重塑人機交互、內容創作、代碼生成等領域的應用開發。對軟件開發者而言,這意味著API與開發工具將更加智能化,能夠理解自然語言指令并自動生成復雜代碼邏輯,極大降低開發門檻,提升效率。其龐大的計算需求、能耗問題以及“黑箱”特性帶來的可解釋性挑戰,也是應用落地中必須面對的現實。

類腦芯片(或稱神經形態計算)嘗試模擬人腦的神經元結構與信息處理機制,以實現高能效、低延遲的并行計算。與傳統馮·諾依曼架構相比,類腦芯片在實時感知、邊緣計算等場景中潛力巨大。對于AI應用軟件開發,這預示著未來應用可以更輕量化地部署在終端設備上,實現實時、自適應的智能響應,如自動駕駛的即時決策、物聯網設備的協同學習等。但這類硬件尚處于早期階段,其編程模型、開發生態以及與現有軟件體系的融合仍需長時間探索。

量子AI結合量子計算與機器學習,旨在利用量子疊加、糾纏等特性,解決經典計算機難以處理的組合優化、大規模模擬等問題。雖然量子硬件仍處于“噪聲中間階段”(NISQ),但其長遠潛力可能徹底改變藥物發現、材料科學、密碼學等領域的AI應用開發模式。軟件開發將需要新的算法框架與編程語言,以適配量子-經典混合計算架構,這對開發者提出了全新的技能要求。

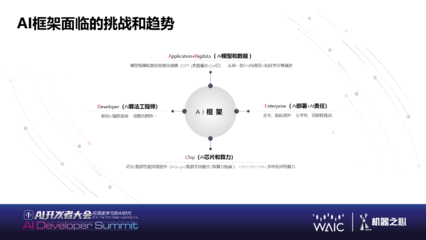

后深度學習時代的AI未來并非由單一技術主宰,而更可能是大規模語言模型、類腦芯片與量子AI相互補充、協同演進的融合生態。大規模語言模型推動軟件開發的自動化與智能化,類腦芯片賦能邊緣與實時應用,量子AI則突破復雜問題的計算極限。作為人工智能應用軟件開發者,擁抱這種多元化趨勢意味著:既要深耕現有AI框架的工程優化,也要保持對新興硬件與范式的敏感度,逐步構建適應異構計算、跨平臺部署的靈活開發能力。成功的AI應用將不僅取決于算法精度,更取決于能否在效能、實時性與可解釋性之間取得平衡,而這正是后深度學習時代留給開發者的核心命題。